Per anni, i deepfake sono stati percepiti dall’opinione pubblica come una curiosità tecnologica, confinata a esperimenti accademici o contenuti virali di intrattenimento. Tuttavia, i dati raccolti nel primo Deepfake Intelligence Report prodotto dalla startup italiana IdentifAI, fondata da Marco Ramilli e Marco Castaldo e specializzata nel riconoscimento di “falsi digitali”, delineano uno scenario drasticamente diverso: siamo entrati in una fase industriale dei media sintetici. Tra il 2020 e i primi mesi del 2026, i deepfake si sono trasformati in uno strumento sistemico e organizzato, capace di colpire simultaneamente l’informazione, la finanza e la sicurezza aziendale su scala globale.

I numeri del fenomeno: il dominio del video

La manipolazione digitale non è più un evento episodico, ma un’attività scalabile e sempre più difficile da intercettare. Grazie all’evoluzione degli algoritmi, i criminali informatici sono ora in grado di agire in tempo reale, rendendo obsoleti i tradizionali meccanismi di protezione delle imprese.

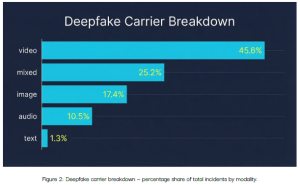

L’analisi di circa 10.000 incidenti globali rivela che il formato video è il vettore d’attacco preferito, rappresentando il 45,6% delle minacce totali. Questa predominanza non è casuale: il video combina immagine, voce e contesto, risultando immediatamente credibile e superando la verifica razionale in un ambiente digitale dominato dalla velocità. Seguono i formati misti (25,2%), le immagini statiche (17,4%) e il voice cloning (10,5%).

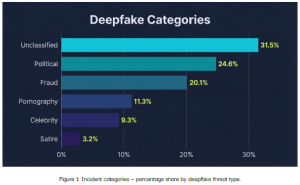

Le motivazioni dietro questi attacchi sono principalmente due: la manipolazione politica (24,6%) e la frode economica (20,1%). Mentre l’obiettivo politico è spesso perseguito da gruppi sostenuti da governi ostili (Advanced Persistent Threats) o hacktivisti per destabilizzare il dibattito pubblico, la frode è il terreno di caccia dei gruppi cybercriminali. Questi ultimi utilizzano i deepfake per abbattere i costi del social engineering, penetrando i sistemi aziendali con una precisione chirurgica.

La geografia del rischio e il ruolo dei social media

Il report evidenzia una forte asimmetria geografica: gli Stati Uniti sono l’epicentro del fenomeno, concentrando il 46,9% degli attacchi. Seguono il Regno Unito (8,2%), l’India (7,2%) e Israele (6,6%). Questa concentrazione riflette la dipendenza dei processi digitali in queste nazioni, che ne amplia la superficie d’attacco.

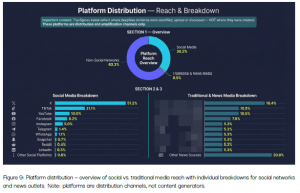

Un ruolo cruciale è giocato dalle piattaforme social, che fungono da motori di amplificazione algoritmica. X (ex Twitter) è il canale primario di distribuzione, coinvolto nel 51,2% degli incidenti rilevati. TikTok segue con il 21,1%, mentre YouTube si attesta al 10%. La logica di queste piattaforme premia la velocità e l’impegno emotivo, permettendo ai contenuti sintetici di diffondersi rapidamente prima che intervengano smentite o verifiche.

Dalla disinformazione alla truffa aziendale

Se in passato il danno era principalmente reputazionale, oggi è diventato immediatamente economico. La qualità dell’inganno è aumentata esponenzialmente: la clonazione vocale e i deepfake in tempo reale permettono ora di simulare conversazioni credibili con dirigenti e responsabili finanziari. I profili apicali delle aziende (C-level) sono diventati i bersagli privilegiati per operazioni di frode sofisticate.

Un esempio emblematico del 2026 ha coinvolto il gruppo di hacker nordcoreano UNC1069, che ha utilizzato un deepfake in tempo reale durante una riunione Zoom per ingannare i dipendenti di una società di criptovalute. Fingendo un problema tecnico all’audio, gli aggressori hanno spinto le vittime a installare un malware, riuscendo a rubare credenziali e fondi. Anche figure pubbliche come l’attrice Scarlett Johansson hanno denunciato l’uso non autorizzato della propria identità digitale, evidenziando la vulnerabilità dei singoli di fronte al furto d’immagine.

La strategia del mix multivariabile

I criminali informatici non utilizzano più un unico vettore, ma orchestrano campagne multivariabili. Ad esempio, una narrazione falsa può essere avviata con un’immagine sintetica su X, validata da un testo generato artificialmente e infine amplificata da video manipolati su TikTok. Questo intreccio di prove sintetiche crea una rete di prove fittizie che sovrasta le attuali capacità di moderazione dei contenuti.

Il report di IdentifAI sottolinea che l’efficacia dei deepfake politici non risiede necessariamente nella perfezione tecnica, ma nella loro plausibilità e capacità di risonanza emotiva all’interno delle camere d’eco algoritmiche. Casi come i dubbi sull’autenticità dei video di leader politici in zone di conflitto (come Israele) dimostrano come il semplice sospetto di un deepfake possa essere utilizzato per alimentare teorie del complotto e destabilizzare la fiducia nelle istituzioni.

Previsioni per i prossimi 12 mesi: il rischio real-time

Il panorama delle minacce è destinato ad aggravarsi. IdentifAI prevede una transizione dalle campagne asincrone (video pre-registrati) allo sfruttamento sincrono in tempo reale. Sono stati identificati tre scenari di rischio sistemico:

- Bypass dei sistemi KYC (Know Your Customer): l’uso di video sintetici per superare i controlli biometrici nelle banche online, permettendo la creazione massiva di account fraudolenti.

- Industrializzazione della frode vocale (BEC): l’automazione della clonazione vocale per attacchi vishing (voice phishing) multilingua contro i dipartimenti finanziari.

- Surge di disinformazione localizzata: campagne iper-specifiche orchestrate da attori statali per inquinare l’ambiente informativo durante finestre geopolitiche critiche.

Emergono inoltre i primi segnali di campagne sintetiche autonome, dove modelli linguistici di grandi dimensioni (LLM) governano sia la logica della conversazione che la generazione di avatar sintetici, ridefinendo la velocità del social engineering.

La roadmap per la resilienza

Per contrastare questa deriva, il report suggerisce un passaggio da una difesa reattiva a una sicurezza integrata a livello infrastrutturale. Le aziende e le istituzioni devono adottare diverse contromisure strategiche:

- Verifiche biometriche multi-modali: integrare l’analisi simultanea di voce e volto per rendere più costoso e complesso l’attacco.

- Standard di provenienza digitale: implementare protocolli come il C2PA per garantire la tracciabilità e l’autenticità dei contenuti multimediali fin dalla loro creazione.

- Rilevamento proattivo: utilizzare motori di analisi basati sul deep learning in grado di identificare le inconsistenze temporali e i micro-artefatti tipici dei video generati da GAN (Generative Adversarial Networks).

- Liability e regolamentazione: revisionare le protezioni di “porto sicuro” per le piattaforme social, rendendole responsabili dell’amplificazione algoritmica di media sintetici dannosi.

In conclusione, la lotta contro i deepfake non riguarda solo la tecnologia, ma la salvaguardia della fiducia. Se non saremo in grado di garantire l’autenticità di ciò che vediamo e ascoltiamo, i presupposti stessi dei nostri sistemi economici e democratici rischiano di venire meno. La soluzione risiede in una combinazione di rigore giornalistico, responsabilità delle piattaforme e, soprattutto, strumenti tecnologici di verifica matematicamente rigorosi.

Analisi degli incidenti Deepfake: minacce, vettori, movente (2020-2026)

| Categoria della Minaccia | Supporto Tecnico (Carrier) | Paese Target | Piattaforma di Distribuzione | Soggetto o Settore Colpito | Percentuale di Incidenti | Movente dell’Attacco |

| Manipolazione politica | Video, Audio, Immagine, Misto | USA, Regno Unito, India, Israele | X, TikTok, YouTube, Facebook | Leader politici, Candidati, Rappresentanti statali | 24,6% | Sovversione politica, Manipolazione dell’opinione pubblica, Disinformazione |

| Frode | Video, Audio (Voice Cloning), Immagine, Misto | USA, Regno Unito, India | X, TikTok, Facebook, Telegram | Dirigenti aziendali (C-level), Responsabili finanziari, Aziende Fintech | 20,1% | Monetizzazione, Estorsione finanziaria, Business Email Compromise (BEC) |

| Pornografia | Immagine, Video | Mondiale (prevalentemente USA) | X, Altre piattaforme social | Donne, Celebrità, Privati cittadini | 11,3% | Abuso sessuale non consensuale, Estorsione, Danno reputazionale |

| Celebrità | Video, Immagine, Audio | USA, Mondiale | TikTok, X, YouTube, Instagram | Attori, Cantanti, Personaggi pubblici (es. Scarlett Johansson, Kanye West) | 9,3% | Uso non autorizzato dell’immagine, Promozione di truffe crypto, Satira |

| Satira | Video, Immagine | Mondiale | X, TikTok | Personaggi pubblici, Politici | 3,2% | Intrattenimento, Critica sociale, Parodia |